Khi các thiết bị thông minh thấm vào cuộc sống của chúng ta, Google sẽ treo cờ đỏ và cho thấy các hệ thống cơ bản có thể bị tấn công như thế nào.

Các thuật toán học máy tương tự có thể tạo ra ô tô tự lái và trợ lý giọng nói có thể bị hack để biến một con mèo thành guacamole hoặc giao hưởng Bach thành các cuộc tấn công dựa trên âm thanh vào điện thoại thông minh.

Đây là những ví dụ về các cuộc tấn công của các hacker chống lại các hệ thống máy học, theo đó ai đó có thể thay đổi một cách tinh tế một hình ảnh hoặc âm thanh để lừa máy tính phân loại sai. Những hệ lụy là rất lớn trong một thế giới ngày càng bão hòa hơn với cái gọi là trí thông minh máy móc.

Tại Hội nghị RSA, nhà nghiên cứu Google Nicholas Carlini đã cung cấp cho người tham dự một cái nhìn tổng quan về các cách thức tấn công có thể không chỉ vô tình làm hỏng hệ thống máy học mà còn vô tình trích xuất thông tin nhạy cảm từ các tập dữ liệu lớn.

Lạm dụng mạng thần kinh

Dưới mỗi cuộc tấn công này là các tập dữ liệu khổng lồ được sử dụng để giúp các thuật toán máy tính nhận ra các mẫu. Một ví dụ Carlini chia sẻ với những người tham dự là một hệ thống phân loại hàng triệu hình ảnh của mèo. Nhờ học máy, máy tính đã nhận ra đặc điểm của một con mèo tốt đến nỗi khi được trình bày với hình ảnh của một con chó, nó có thể tự tin xác định hình ảnh là không phù hợp.

Nhưng, Carlini nói rằng các nhà khoa học dữ liệu đã tìm thấy điểm yếu có thể khai thác trong cách máy tính xử lý các tập dữ liệu lớn được sử dụng trong học máy. Các nhà khoa học dữ liệu gọi các bộ dữ liệu này, khi được sử dụng với máy học, mạng lưới thần kinh – các hệ thống bắt chước cách thức hoạt động của não.

Hai hình ảnh này [của mèo], về cơ bản không thể phân biệt được với tất cả chúng ta là con người, là những đối tượng hoàn toàn khác nhau từ quan điểm của một mạng lưới thần kinh, ông nói. Sự khác biệt duy nhất giữa hai là các chấm nhỏ trên một trong các hình ảnh, đủ để gây nhầm lẫn mạng lưới thần kinh để phân loại nó là guacamole.

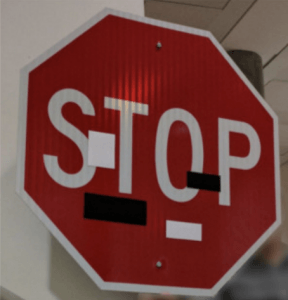

Khi nói đến việc sử dụng kỹ thuật này trong bối cảnh của một cuộc tấn công bất lợi, Carlini nói, hãy xem xét ý nghĩa của một dấu hiệu dừng lại được hiểu bởi một chiếc xe tự lái là một dấu hiệu giới hạn tốc độ 45 dặm / giờ.

Tấn công âm thanh

Ông nói điều quan trọng cần lưu ý rằng đây không chỉ là vấn đề tồn tại với hình ảnh mà còn với âm thanh, ông nói.

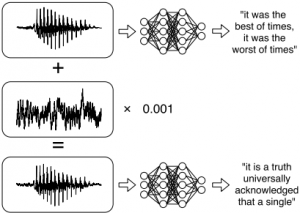

Carlini sau đó đã chơi một đoạn trích nhạc cụ của một bản giao hưởng JS Bach. Tiếp theo, một nhà phân tích giọng nói thành văn bản được sử dụng bởi một mạng thần kinh đã giải thích âm thanh là một trích dẫn của Charles Dickens, Thời gian đó là thời điểm tốt nhất, đó là thời điểm tồi tệ nhất. .

Minh họa về cuộc tấn công cho thấy cách đưa ra bất kỳ dạng sóng nào, việc thêm một nhiễu loạn nhỏ làm cho kết quả được phiên mã thành bất kỳ cụm từ mục tiêu mong muốn nào.

Minh họa về cuộc tấn công cho thấy cách đưa ra bất kỳ dạng sóng nào, việc thêm một nhiễu loạn nhỏ làm cho kết quả được phiên mã thành bất kỳ cụm từ mục tiêu mong muốn nào.

Sẽ thật tệ nếu tôi đi đến điện thoại của bạn và nói, ‘chuyển tiếp email gần đây nhất của bạn cho tôi’ hoặc ‘duyệt đến một trang web độc hại nào đó’, anh nói. Với âm thanh được ngụy trang đúng, một kẻ thù có thể ra lệnh cho điện thoại Android thực hiện bất kỳ số lượng tác vụ rủi ro nào.

Tôi chỉ có thể phát một số âm thanh nhúng video YouTube và bây giờ bất cứ ai xem video đều nhận được lệnh, anh ấy nói.

Low bar để tấn công

Các cuộc tấn công tự nó không tinh vi hoặc khó thực hiện. Chúng dựa trên cách các mạng lưới thần kinh phân loại hình ảnh. Đây là một lời giải thích đơn giản.

Ví dụ về một dấu hiệu dừng được hack để được xác định là một dấu hiệu giới hạn tốc độ bởi một mạng lưới thần kinh.

Ví dụ về một dấu hiệu dừng được hack để được xác định là một dấu hiệu giới hạn tốc độ bởi một mạng lưới thần kinh.

Học máy xếp hạng hình ảnh với độ tin cậy phần trăm để tạo nhóm phân loại. Ví dụ, hình ảnh rõ nét, sắc nét của một con mèo có thể có khả năng là một con mèo trong chương trình học máy, và được phân loại như vậy. Thêm một dấu chấm không thể nhận dạng vào hình ảnh con mèo và mạng lưới thần kinh có thể giảm tỷ lệ phần trăm khả năng nó là một con mèo xuống 97,5 phần trăm. Với đủ các thay đổi không thể nhận ra (dấu chấm), sự tự tin của mạng lưới thần kinh trong việc xác định con mèo bị xói mòn. Ở một ngưỡng nhất định, mạng lưới thần kinh dừng nhìn thấy hình ảnh như một con mèo và nhảy sang hình ảnh rất có thể tiếp theo. Trong ví dụ Carlini chia sẻ, gần nhất tiếp theo là guacamole.

Đây thực sự không khó để tạo ra những kiểu tấn công như vậy, ông nói. Ông nói thêm rằng việc áp dụng toán học có thể giúp một kẻ thù giảm thiểu thời gian cần thiết để tạo ra một hình ảnh lừa đảo có thể thách thức lẽ thường.

Nếu bạn có thể tính toán đạo hàm của hình ảnh và mạng lưới thần kinh đối với một số chức năng mất, bạn có thể dễ dàng tối đa hóa việc phân loại sai như thế nào, ông nói.

Quyền riêng tư của dữ liệu đào tạo

Khi học máy được áp dụng bởi nhiều ngành công nghiệp muốn sử dụng trí thông minh mạng thần kinh để giải quyết vấn đề, một số rủi ro riêng tư là cố hữu, Carlini nói. Ví dụ, bệnh viện, nhà bán lẻ và chính phủ có thể muốn tạo ra một mạng lưới thần kinh dựa trên một loạt các bộ dữ liệu nhạy cảm.

Carlini cảnh báo nếu các giới hạn phù hợp không được áp dụng cho các bộ dữ liệu đó, thông tin cá nhân có thể được trích xuất bởi một kẻ thù chỉ có quyền truy cập hạn chế vào dữ liệu thực tế.

Trong bối cảnh này, các mạng thần kinh được sử dụng trong các mô hình dự đoán cho các truy vấn. Ví dụ: email hoặc ứng dụng văn bản thường sẽ dự đoán từ tiếp theo bạn sẽ sử dụng. Khi điều này được áp dụng với một tập dữ liệu có nhiều thông tin nhạy cảm, nó có thể vô tình cho phép một kẻ thù truy vấn cơ sở dữ liệu để rò rỉ thông tin.

Một ví dụ đã được chứng minh là khi ai đó bắt đầu nhập số an sinh xã hội của Nicolas Nicolas là thuật toán đã truy vấn bộ dữ liệu và đưa ra câu trả lời đúng thông qua tự động hoàn tất. Các kịch bản khác bao gồm các tập dữ liệu với dữ liệu điều trị ung thư, thông tin và địa chỉ thẻ tín dụng.

[Công ty] nên suy nghĩ kỹ trước khi sử dụng máy học với dữ liệu đào tạo. Có thể lấy dữ liệu riêng tư, ngay cả khi người dùng chỉ có quyền truy cập truy vấn vào mô hình, ông nói.

Chìa khóa để bảo vệ rò rỉ thông tin, Carlini cho biết, trước tiên là giảm việc ghi nhớ dữ liệu trên mạng dữ liệu trong bộ dữ liệu thành những gì cần thiết cho một nhiệm vụ.

Lý do đầu tiên mà bạn nên cẩn thận khi sử dụng máy học là sự thiếu mạnh mẽ rõ ràng này. Các phân loại học máy khá dễ bị đánh lừa, ông nói. Trong một thế giới nơi máy tính có thể thấy dấu hiệu dừng là dấu hiệu 45 dặm / giờ và âm nhạc được công nhận là lời nói để điều khiển các thiết bị thông minh từ xa, các nhà thiết kế mạng thần kinh nên suy nghĩ cẩn thận về cách họ xây dựng hệ thống của mình, ông nói.